Technology

AIME

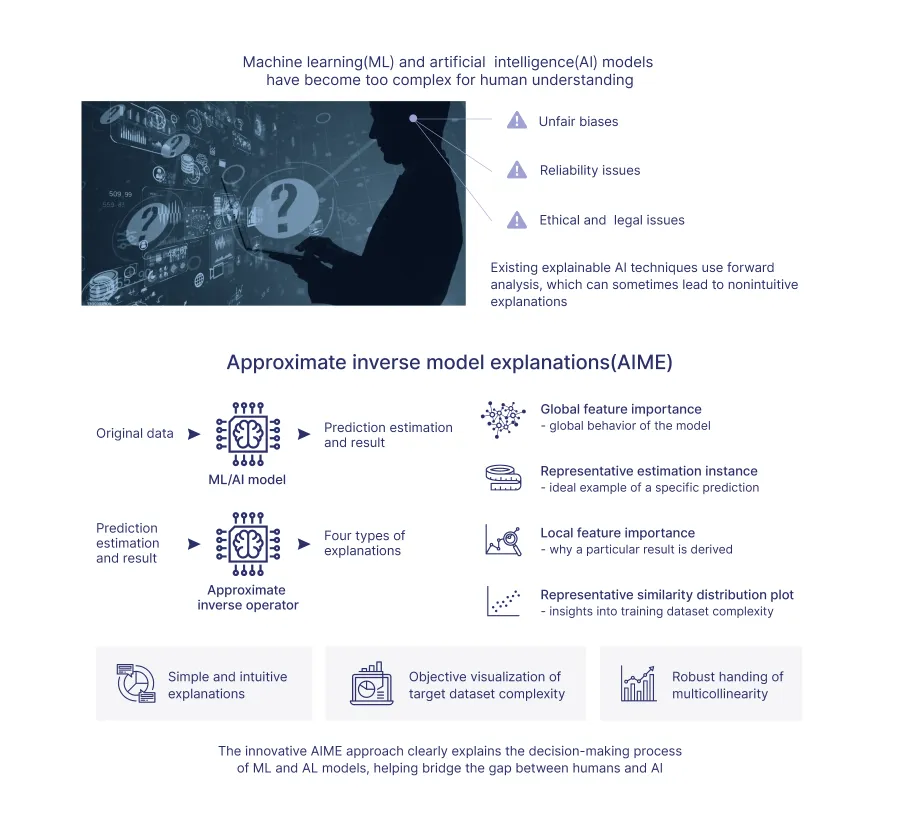

AIが導出した推定結果についてシンプルでわかりやすい説明を導出する独自技術

(日本特許登録済(特許第7533997号)、PCT出願済み、米国、ヨーロッパ、中国での出願準備中)

あなたが生成系AIを含めて使いづらいと思ったのは、なぜAIがなぜその答えを導き出したかという説明がないからではないでしょうか。人間の子供だって、何か悪いことをして注意して理由を聞けば、後付けで理由を答えてくれます。実は今のAIの中身は複雑すぎて開発した人間にとっても理解しづらい「ブラックボックス」となっていることが多いのです。

「ブラックボックス」であるAIを使って、本当に責任のある仕事ができるでしょうか。例えばお医者さんが診断の補助のためにAIを使った時、なぜAIがそのリスクを指摘したのか説明できなければ使えません。面接官がAIであることもあります。ただ、そのAI面接官がなぜAさんを不合格にし、Bさんを合格にしたかを説明できなければ、不公平といわれても仕方ありません。さらに、将来、自動運転車が普及して、事故をしたとき、原因を把握するのに、AIの判断の理由の説明ができなければ、誰が、何が、どういうふうに過失があるのかわからず、保険料を決めることさえ難しい案件となるでしょう。

「ブラックボックス」であるAIを使って、本当に責任のある仕事ができるでしょうか。例えばお医者さんが診断の補助のためにAIを使った時、なぜAIがそのリスクを指摘したのか説明できなければ使えません。面接官がAIであることもあります。ただ、そのAI面接官がなぜAさんを不合格にし、Bさんを合格にしたかを説明できなければ、不公平といわれても仕方ありません。さらに、将来、自動運転車が普及して、事故をしたとき、原因を把握するのに、AIの判断の理由の説明ができなければ、誰が、何が、どういうふうに過失があるのかわからず、保険料を決めることさえ難しい案件となるでしょう。

我々人間がより進化をするためには、AIがより人間に寄り添い、公平で説明をしてくれる透明性の高いAIが求められます。それを実現するのがApproximate Inverse Model Explanations―AIMEです。

AIMEは人間が難しい数学の問題を解いた時に逆から検算するような方法で、AIの推定結果の説明を導出します(具体的な基本アイデアについてはこちらをご覧ください)。

今後ビジネスでなんらかのAIを用いた製品・サービスを提供する際に、必ず必要となる公平性、説明可能性、透明性を担保する技術がAIMEです。

Approximate Inverse Model Explanations for Intuitive Machine Learning Model Predictions